Первоначальная установка системы с резервированием, в кластере из двух серверов

Исходные данные

Вариант с резервом, используется на проектах чаще , поэтому его мы рассмотрим первым. Пример установки на одном сервере

Конфигурация системы в кластере из двух серверов

По техническому заданию требуется определить аппаратную платформу.

Полоса пропускания СПД

Требуемая полоса пропускания СПД не менее 1000Mb/s

Пример составления аппаратных требований:

Включение в сеть

Топологию включения сервера в сеть для обеспечения резервирования рекомендуется делать с использованием 2-х коммутаторов. Пример на рисунке ниже.

Рисунок 1 — Схема организации связи

Вариант 1. Схема active-backup

Коммутаторы связаны между собой в erps-кольцо.

Все 4 физических сетевых интерфейса каждого сервера объединяются в 1 агрегированный линк (bond). Агрегация портов сервера настраивается в режиме active-backup, т.е. в работе всегда находится только 1 сетевой интерфейс. Сетевые интерфейсы каждого сервера попарно включены в коммутаторы, на которых агрегация портов (port-channel) также настраивается в режиме active-backup. Например, eth1 и eth2 каждого сервера включаются в первый коммутатор (port-channel 1 и 2), а eth3 и eth4 (port-channel 3 и 4) — во второй.

Вариант 2. Схема LACP

Коммутаторы связаны между собой в стек. Стек должен логически работать как один коммутатор, способный обеспечивать агрегацию портов в режиме LACP между разными физическими коммутаторами. Пример — коммутаторы MES-3124 со специализированной прошивкой.

Все 4 физических сетевых интерфейса также объединяются в 1 агрегированный линк (bond). Агрегация портов сервера настраивается в режиме 802.3ad. Создаются агрегированные группы сетевых карт с одинаковой скоростью и дуплексом. При таком объединении передача задействует все каналы в активной агрегации согласно стандарту IEEE 802.3ad. Выбор того, через какой интерфейс необходимо отправлять пакет, определяется политикой. По умолчанию это XOR-политика, можно использовать «xmit_hash» политику. Подробнее — в разделе Приложение Е. Netplan.

Требования:

- Поддержка Ethtool в драйвере для получения информации о скорости и дуплексе на каждом сетевом интерфейсе;

- Поддержка на коммутаторе стандарта IEEE 802.3ad;

Сетевые интерфейсы сервера также попарно включены в коммутаторы, на которых агрегация портов (port-channel) тоже настраивается в режиме LACP. Например, eth1 и eth2 каждого сервера включаются в первый коммутатор (port-channel 1 и 2), а eth3 и eth4 (port-channel 3 и 4) — во второй.

Последовательность установки SSW ECSS10 в кластере из двух серверов

Установка SSW ECSS10 состоит из 2-х основных частей :

Подготовительной - Установка ОС Astra Linux 1.7, обновлений пакетов OC Astra Linux 1.7 , установка дополнительных пакетов программ, подготовка сетевых интерфейсов, /etc/hosts, ssh-keygen

- Установка приложений Eltex ECSS10

Подготовительный этап

В этом разделе приведено описание инсталляции операционной системы, а также необходимых и дополнительных пакетов. Система ECSS-10 версии 3.14 работает под управлением ОС Astra Linux 1.7.

Предварительные требования

- Установочный загрузочный носитель с дистрибутивом операционной системы;

- Подготовленный сервер с обновленным BIOS, ILO (если есть), подключенная сеть для доступа;

- Выставленный первый приоритет загрузки с установочного носителя — USB Flash или CD/DVD в BIOS;

- Достаточный объем дискового пространства и памяти в соответствии с проектом.

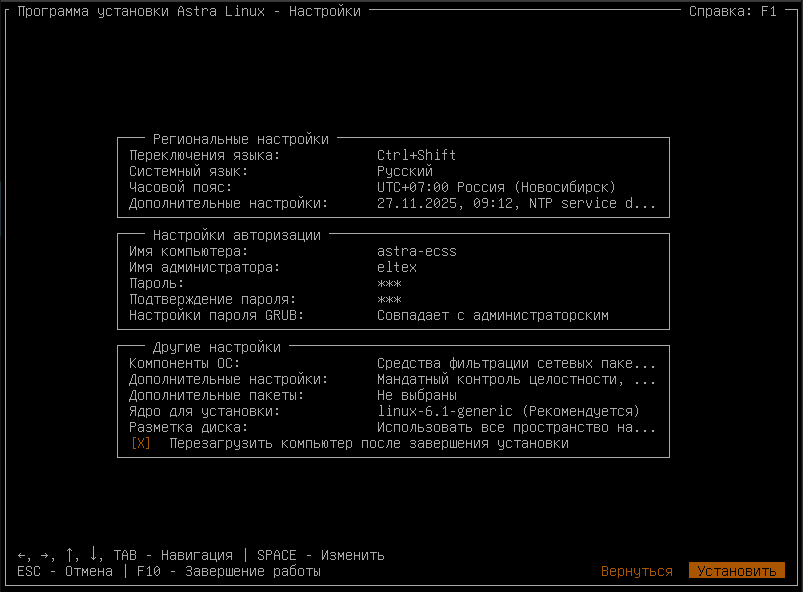

Установка ОС

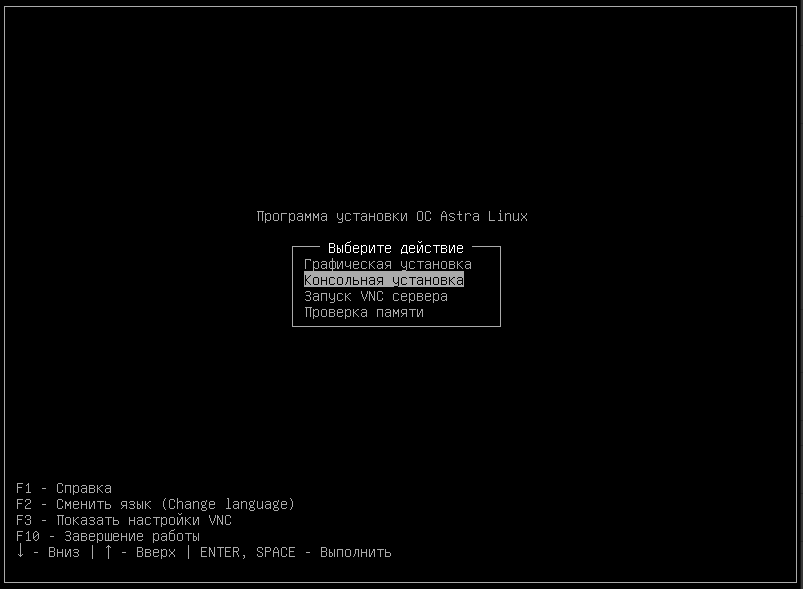

Для установки ОС необходимо выполнить следующее:

- После загрузки с установочного носителя выбрать "Графическая установка" или "Установка".

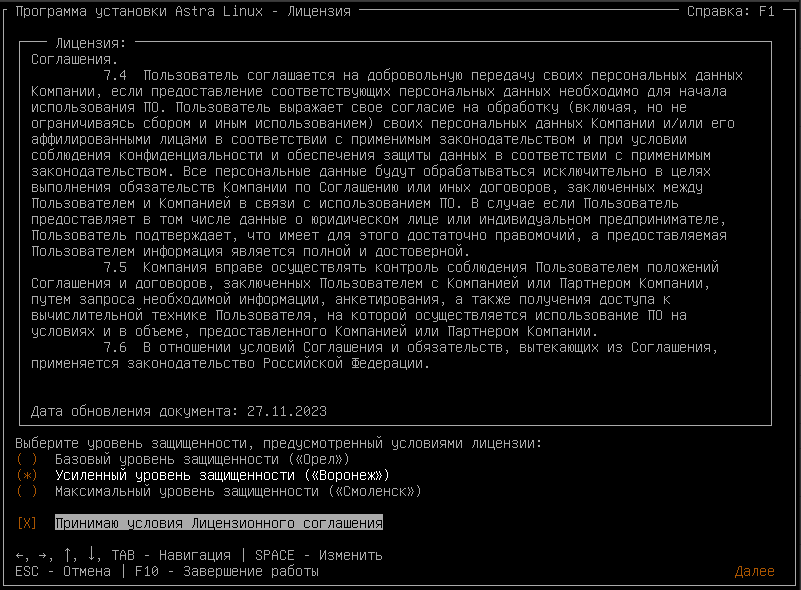

- Согласится с лицензионным соглашением.

- Выбрать раскладку клавиатуры.

Выбрать сетевой интерфейс для подключения к сети Интернет.

- Установить имя компьютера (рекомендованы ecss1/ecss2)

- Настроить пользователя- администратора.

- Создать партиции на диске в соответствии с таблицей 1 (разметка диска - Вручную).

- В процессе установке , не создавать раздел swap . При напоминании о пропуске раздела , подтвердить , что установка выполняется без создания swap.

- Установить часовой пояс.

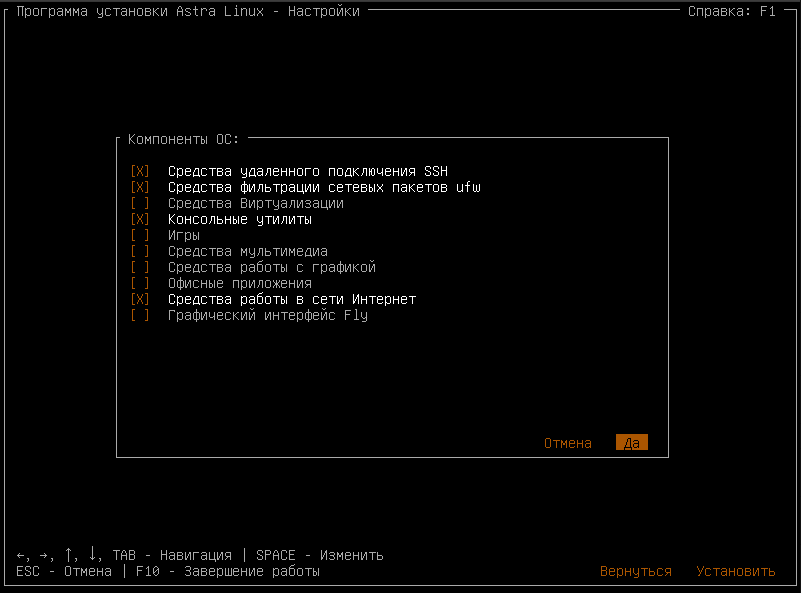

- Установить OpenSSH server (активизировать пункт : "Средства удаленного подключения SSH" ).

- Выбрать уровень защищенности, который используется в вашем проекте

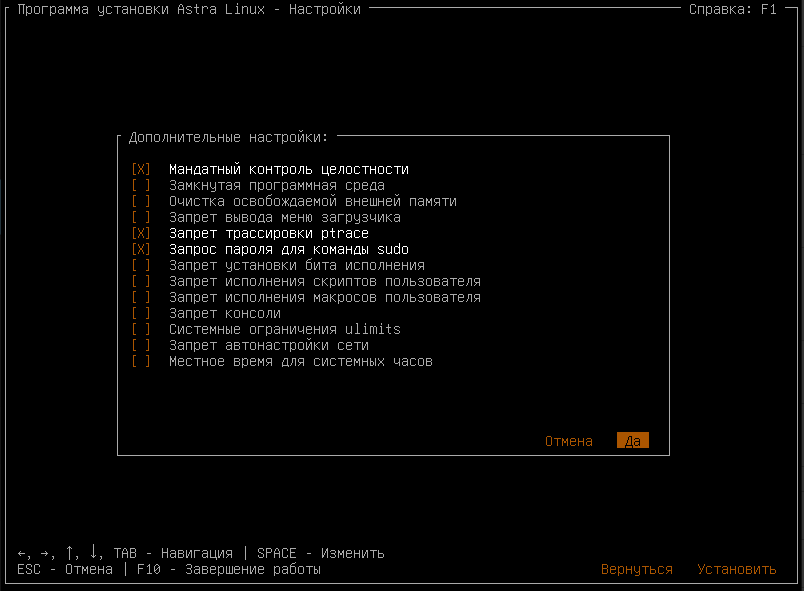

- Дополнительные настройки ОС - по умолчанию

- Перезагрузить успешно установленную ОС

Таблица 1 — Вариант размещения информации в файловой системе на физических носителях для серверов

| 1 | Загрузочный раздел операционной системы (создается автоматически) | boot | raid 1:hdd1,hdd2 | boot | /boot | ext4 | 1 Gb | Первичный |

| 2 | Корневой раздел операционной системы | root | raid 1:hdd1,hdd2 | root | / | ext4 | 30 Gb | Логический |

| 3 | Информация локальных баз данных | mnesia | raid 1:hdd1, hdd2 | mnesia | /var/lib/ecss | ext4 | 30 Gb | Логический |

| 4 | Распределенная БД для хранения медиаресурсов | glusterfs | raid 1:hdd1, hdd2 или hdd3 | glusterfs | /var/lib/ecss/glusterfs* | ext4 | Max Gb | Логический |

| 5 | Журналы функционирования подсистем ОС | log | raid 1:hdd1,hdd2 или hdd3 | log | /var/log | ext4 | 20 Gb | Логический |

| 6 | Журналы функционирования подсистем ECSS | ecss_log | raid 1:hdd1,hdd2 или hdd3 | ecss_log | /var/log/ecss | ext4 | 20 Gb | Логический |

| 7 | Базы данных | ecss_db | raid 1:hdd1,hdd2 или hdd3 | ecss_db | /srv/ecss/ecss-postgres-bdr-ssw/ | ext4 | 100–400 Gb** | Логический |

| 8 | Файлы пользователя | home | raid 1:hdd1,hdd2 или hdd3 | home | /home | ext4 | 10 Gb | Логический |

* Если сервер не будет работать в кластере, то вместо glusterfs создается раздел /var/lib/ecss/restfs.

** Рекомендуемое значение для серий Light, Light+, Midi — 100 Gb. Рекомендуемое значение для серии Heavy — 200 Gb, Super Heavy — 400 Gb.

Для работы системы необходимо как минимум 256 Gb свободного пространства.

На серверах системы необходимо настроить параметр "hostname".

На всех серверах системы желательно указать одинаковое имя пользователя (любое, кроме ssw). Лицензия ECSS-10 привязывается к ключу eToken/ruToken и к имени компьютера (hostname). Системный пользователь ssw создается при инсталляции пакета ecss-user.

При установке системы в кластере, рекомендуемое значение для первого сервера — ecss1, для второго — ecss2.

Проверка установки ОС

Проверка в основном сводится к правильности создания разделов диска и наличия доступа по ssh.

Для вывода информации о состоянии дискового пространства введите команду df -h. Она покажет общее и занятое место в разделах. Размеры разделов должны соответствовать проекту и введенным значениям при установке.

Для проверки доступа по ssh с машины, находящейся в одной подсети со вновь установленным сервером, нужно выполнить команду:

ssh <user>@<IP_ecss>

где:

- <user> — имя пользователя, заданного при установке;

- <IP_ecss> — IP-адрес хоста, заданного при установке.

Настройка /etc/hosts

Доменному имени хоста ecss1 должен соответствовать адрес 127.0.1.1. Также нужно прописать адрес хоста ecss2. Для этого в файле /etc/hosts необходимо прописать IP-адреса хостов ecss.

Например, для кластера: ecss1 имеет адрес 10.0.10.41, ecss2 — 10.0.10.42. Данные адреса нужно прописать в /etc/hosts:

посмотреть можно командой cat /etc/hosts

изменить/добавить командой sudo nano /etc/hosts

после модификации должен проходить пинг с сервера ecss1 ping ecss2 и наоборот с сервера ecss2 ping ecss1

sudo nano /etc/hosts

127.0.0.1 localhost 10.0.10.41 ecss1 10.0.10.42 ecss2

127.0.0.1 localhost 10.0.10.42 ecss2 10.0.10.41 ecss1

Конфигурация репозиториев

После установки для обновления будет использоваться только образ DVD диска, загрузка с репозитория отключена.

Давайте разрешим обновление пакетов с локального репозитория Eltex.

Копируем образ репозитория Eltex в локальную директорию.

scp eltex_repo_latest.tar.gz eltex@10.0.20.41:/home/eltex

И распаковываем архив.

Пример:

tar -xzf eltex_repo_latest.tar.gz

Перемещаем директорию с Eltex пакетами в /var/spool/:

sudo mv eltex_repo /var/spool/

sudo apt-key add eltex_repo_gpg.key

Редактируем source.list

echo "deb file:/var/spool/eltex_repo 1.8_x86-64 contrib main non-free" | sudo tee -a /etc/apt/sources.list

Изменение приоритета репозиториев

Для установки Erlang, Nodejs и Elixir из репозитория Eltex, необходимо изменить приоритет репозиториев для данных пакетов.

Добавить в файл /etc/apt/preferences.d/erlang строки:

sudo sh -c "echo -e 'Package: erlang*\nPin: version 2:24.3*\nPin-Priority: 1000' >> /etc/apt/preferences.d/erlang"

Добавить в файл /etc/apt/preferences.d/nodejs строки:

sudo sh -c "echo -e 'Package: nodejs*\nPin: version 14.20.0-1nodesource1*\nPin-Priority: 1000' >> /etc/apt/preferences.d/nodejs"

Добавить в файл /etc/apt/preferences.d/elixir строки:

sudo sh -c "echo -e 'Package: elixir*\nPin: version 1.14*\nPin-Priority: 1000' >> /etc/apt/preferences.d/elixir"

Выполнить обновление:

sudo apt update

"Оптимизация" Операционной Системы

Выставить параметры ОС в режим производительности

Используем утилиту cpufrequtils.

sudo apt install cpufrequtils

по умолчанию после инсталляции ОС использует режим "ondemand" - "по запросу" (производительность CPU по запросу приложений, экономит электроэнергию , но ниже производительность):

cat /etc/init.d/cpufrequtils | grep GOVERNOR=

в выходном сообщении системы , режим работы по умолчанию после инсталляции - "ondemand" :

GOVERNOR="ondemand"

Установить режим - результативность/производительность - в файле /etc/init.d/cpufrequtils значение "ondemand" заменить на "performance"

sudo sed -i 's/GOVERNOR="ondemand"/GOVERNOR="performance"/g' /etc/init.d/cpufrequtils

Перезапустить утилиту:

sudo /etc/init.d/cpufrequtils restart

Затем выполнить команду:

sudo systemctl daemon-reload

Отключить SWAP

Ubuntu сервер SSW работает в реальном масштабе времени , поэтому все необходимые данные должны находится в оперативной памяти, использование файла подкачки (swap-файл - /swap. img) может привести к увеличению времени обработки вызовов приложения SSW ECSS10 , что недопустимо. Swap - отключаем.

Выполнить последовательно три команды:

Отключение Swap:

sudo swapoff -a

Удалить файл swap.img.

sudo rm /swapfile

Удалить эту строчку (//swapfile swap swap defaults 0 0)

sudo nano /etc/fstab

# /etc/fstab: static file system information. # # Use 'blkid' to print the universally unique identifier for a # device; this may be used with UUID= as a more robust way to name devices # that works even if disks are added and removed. See fstab(5). # # <file system> <mount point> <type> <options> <dump> <pass> # / was on /dev/sda2 during curtin installation UUID=4c88cb4a-42c9-4b52-98c2-78da7e23b621 / ext4 defaults 1 1

Для проверки выполните команду free -h:

free -h

Размер Swap равен 0 - то есть он выключен

free -h

total used free shared buff/cache available

Mem: 3,9G 110M 3,2G 820K 535M 3,5G

Swap: 0B 0B 0B

Установка часового пояса

При инсталляции astara linux не предлагается установить часовой пояс(по умолчанию устанавливается время UTC). Его нужно установить вручную (для корректной работы системы тарификации , работ по расписанию и т.д. ), например:

sudo timedatectl set-timezone Asia/Novosibirsk

Улучшение работы высоконагруженных серверов

Улучшить работу высоконагруженных серверов можно увеличив лимит открытых файлов.

Для установки лимита открытых файлов необходимо:

Проверить текущий лимит командой:

ulimit -a

результат :

eltex@ecss1:~$ ulimit -a core file size (blocks, -c) 0 data seg size (kbytes, -d) unlimited scheduling priority (-e) 0 file size (blocks, -f) unlimited pending signals (-i) 15515 max locked memory (kbytes, -l) 65536 max memory size (kbytes, -m) unlimited open files (-n) 1024 pipe size (512 bytes, -p) 8 POSIX message queues (bytes, -q) 819200 real-time priority (-r) 0 stack size (kbytes, -s) 8192 cpu time (seconds, -t) unlimited max user processes (-u) 15515 virtual memory (kbytes, -v) unlimited file locks (-x) unlimited

Данного лимита ( open files 1024 ) недостаточно для нормальной работы высоконагруженных серверов.

Установить лимит открытых файл для каждого пользователя:

sudo sed -i '55i\* soft nproc 65536\n* hard nproc 131072\n* soft nofile 65536\n* hard nofile 131072\nroot - memlock unlimited' /etc/security/limits.conf

Настройка сетевых интерфейсов

Получение адресов на сетевых интерфейсах по DHCP недопустимо на серверах ECSS.

Сетевые настройки необходимо выполнять с помощью Netplan.

По умолчанию в Astra Linux пакет netplan не установлен.

Установить пакеты для обслуживание функции netplan:

sudo apt install -y dialog libssl1.0.0 netplan.io

Сейчас можно выполнить конфигурацию netplan:

sudo nano /etc/netplan/ecss.yaml

Пример netplan для режима active-backup

| Netplan для интерфейсов сервера ecss1 (/etc/netplan/ecss.yaml) | Netplan для интерфейсов сервера ecss2 (/etc/netplan/ecss.yaml) |

|---|---|

на ecss1 # Netplan для хоста ecss1 программного коммутатора

# Обратите внимание на обязательное наличие минимум двух пробелов в каждой строке и секции (кроме строки секции network)

network:

version: 2 # Версия netplan

renderer: networkd # Исполнитель конфигураций netplan

ethernets: # Раздел описания интерфейсов ethernet

enp0s3: # Название внутреннего интерфейса ВМ

dhcp4: no # Отключаем на интерфейсах динамическое распределение IP-адреса

addresses: [192.168.56.41/24] # Интерфейс управления ОАМ

gateway4: 192.168.56.1

enp0s8: # Название внешнего интерфейса ВМ

dhcp4: no # Отключаем на интерфейсах динамическое распределение IP-адреса

vlans:

net.10: # Интерфейс управления/Postgres

id: 10

link: enp0s8

addresses: [10.0.10.41/24]# Адрес для Postgres

net.20: # Интерфейс для VoIP

id: 20

link: enp0s8

addresses: [10.0.20.41/24]# Адрес для VoIP / SIP

routes:

- to: 10.0.20.0/24

via: 10.0.20.1

| на ecss2 # Netplan для хоста ecss2 программного коммутатора

# Обратите внимание на обязательное наличие минимум двух пробелов в каждой строке и секции (кроме строки секции network)

network:

version: 2 # Версия netplan

renderer: networkd # Исполнитель конфигураций netplan

ethernets: # Раздел описания интерфейсов ethernet

enp0s3: # Название внутреннего интерфейса ВМ

dhcp4: no # Отключаем на интерфейсах динамическое распределение IP-адреса

addresses: [192.168.56.42/24] # Интерфейс управления ОАМ

gateway4: 192.168.56.1

enp0s8: # Название внешнего интерфейса ВМ

dhcp4: no # Отключаем на интерфейсах динамическое распределение IP-адреса

vlans:

net.10: # Интерфейс управления/Postgres

id: 10

link: enp0s8

addresses: [10.0.10.42/24]# Адрес для Postgres

net.20: # Интерфейс для VoIP

id: 20

link: enp0s8

addresses: [10.0.20.42/24]# Адрес для VoIP / SIP

routes:

- to: 10.0.20.0/24

via: 10.0.20.1

|

Так же проверить отсутствие в каталоге /etc/netplan/ других файлов, если другие файлы присутствуют , то их нужно переместить в другой каталог или удалить, в противном случае возможна некорректная настройка сетевых интерфейсов и некорректная работа SSW.

ls -la /etc/netplan/

Применить, установленные параметры командой:

sudo netplan apply

Просмотреть получившиеся настройки можно при помощи команд ifconfig или ip a:

Для применения новых сетевых настроек необходимо выполнить команду netplan apply. Перезапуск сети или системы не требуется. Подробнее про настройки netplan см. в Приложении Е. Netplan.

Обновление ОС и инсталляция необходимого ПО

Обновление системы

Перед началом установки необходимо обновить ОС:

sudo apt update

sudo apt upgrade --enable-upgrade

Доступ между серверами без использования пароля

Далее следует разрешить доступ между серверами с через ssh по rsa-ключам - без использования пароля.

На хосте ecss1 (затем на ecss2) сгенерировать rsa-ключ следующий командой (выполнить без sudo, чтобы ключ был создан для текущего пользователя), на вопросы, использовать значение по умолчанию, нажав три раза Enter:

ssh-keygen

Скопировать rsa-ключ на сервер партнера ecss2 командой - ssh-copy-id ecss2.

ssh-copy-id ecss2

Скопировать rsa-ключ на сервер партнера ecss1 командой - ssh-copy-id ecss1.

ssh-copy-id ecss1

Проверить подключение между серверами, со стороны сервера ecss1 - ssh ecss2 соединение должно быть установлено без запроса пароля . По окончанию теста вернутся обратно на сервер ecss1 , командой exit.

ssh ecss2

Аналогичным образом со стороны сервера ecss2 - ssh ecss1 соединение должно быть установлено без запроса пароля . По окончанию теста вернутся обратно на сервер ecss2 , командой exit.

ssh ecss1

Инсталляция необходимого ПО

Установка дополнительных пакетов программ

Для работы SSW, потребуются дополнительные пакеты ПО не установленные в Astra Linux по умолчанию, но доступные в "eltex_repo_latest" репозитории.

sudo apt install ntp iptables tcpdump vlan dnsmasq aptitude atop ethtool htop mc minicom mtr-tiny nmap pptpd screen ssh tftpd-hpa sngrep tshark gnuplot debconf-utils keepalived attr bridge-utils ncdu wget

Для просмотра установленных пакетов выполнить следующую команду (данный пункт является необязательным: его можно выполнить, если не уверены, что какие-то пакеты установлены):

sudo dpkg --get-selections

Перед началом установки пакетов ecss , нужно убедится в соответствии полосы пропускания СПД необходимым требованиям.

Для этого выполнить команду sudo ethtool <имя интерфейса> для всех физических интерфейсов.

Проверить значение следующих параметров:

Advertised auto-negotiation: Yes

Speed: 1000Mb/s (не менее)

Duplex: Full

Инсталляция пакетов ECSS

Предварительные требования

- Установленная и обновленная операционная система Astra Linux;

- Отсутствие в системе пользователя с именем ssw;

- Разбиение дискового пространства в соответствии с рекомендациями;

- Настроенная сеть;

- Установленный набор необходимых пакетов;

- Наличие локального файла репозитория Eltex.

установка пакетов deb

┌ версия ПО ECSS. Сейчас в заявке на сертификацию она заявлена как 3.

| Мы её менять не будем до следующей сертификации или │ выпуска принципиально новой версии системы. │ │ ┌ версия System Release. Общая версия для всех компонент входящих в конкретный релиз.

| | Меняем её централизовано, когда

│ │ принимаем решение о выпуске нового релиза. Релизы между собой обычно не совместимы.

┌─┴┐ ┌──┴─┐

ECSS.SysRel.SubMaj.SubMin

└──┬─┘ └──┬─┘

│ └ версия Subsystem minor. Минорную версию подсистемы устанавливает разработчик подсистемы. | Минорную версию

│ меняем при добавлении патча. Как правило, минорные версии в рамках одной мажорной версии

│ совместимы между собой и отличаются в рамках конкретных патчей.

│

└ версия Subsystem major. Мажорная версия устанавливается разработчиком подсистемы. Мажорную версию подсистемы необходимо менять при внесении в подсистему существенных изменений.

Утилита установки пакетов APT анализирует версию пакета слева направо, для примера, мы имеем пакет 14.14.7.7 ,

в репозитории находятся пакеты

14.14.7.8

14.14.7.9

14.14.8.1

14.14.20 -14.14.28

то при выполнении команды sudo apt install имя пакета → будет автоматически проверен и установлен пакет 14.14.28 , так как он самый последний, анализ будет выполнен по 3-й позиции (major), анализ по 4-й (minor) выполнен не будет (аналогичным образом будет выполнятся команда sudo apt upgrade --enable-upgrade).

В случае если для конкретной ситуации требуется перейти с версии 14.14.7.7 на версию 14.14.7.9 , стандартная команда → sudo apt upgrade --enable-upgrade , нам не поможет, так как будет выбран самый новый пакет, в данной ситуации нам необходимо в явном виде указать какую версию пакета мы хотим установить, в данном примере мы должны выбрать команду → sudo apt install имя пакета=14.14.7.9 . Обычно это необходимо для тестирования определенного патча, для стандартных обновлений достаточно выбора привычной команды установки/обновления пакета

В ходе установки пакетов ECSS нужно будет ответить на ряд вопросов для формирования необходимой конфигурации. Для автоматической загрузки требуемых настроек можно воспользоваться командами из пакета debconf-utils.

Описание и примеры использования при работе с debconf приведены в Приложении В. Debconf.

Для инсталляции системы ECSS-10 необходимо устанавливать пакеты в порядке, в котором они описаны ниже в документации.

Инсталляция обязательных пакетов

Установка пакета ecss-dns-env

Выполнить следующую команду:

sudo apt install -y ecss-dns-env

Настройщик предложит выбрать разделы для настройки по вопросам ниже. Нужно выбрать broker. (для примера 10.0.10.51 и 10.0.10.52 )

| Вопрос ecss-dns-env | Ответы для ecss1 | Ответы для ecss2 | Пример |

|---|---|---|---|

| [Primary broker] Введите адрес ([Primary broker] Enter ip) | 10.0.10.41 (необходимо ввести) | 10.0.10.41 (необходимо ввести) | |

| [Secondary broker] Введите адрес ([Secondary broker] Enter ip) | 10.0.10.42 (необходимо ввести) | 10.0.10.42 (необходимо ввести) |

ВАЖНО

В случае последующей коррекции IP-адресов следует использовать команду:

sudo dpkg-reconfigure ecss-dns-env

Для корректной работы системы, после установки пакета ecss-node требуется скорректировать дефолтные установки . Для этого: В файле /etc/resolv.conf изменить параметр nameserver установленный системой по умолчанию на 127.0.0.1 (если строк nameserver несколько - остальные удалить/закомментировать): В Astra Linux после перезагрузки файл /etc/resolv.conf приводится к исходному виду, поэтому его нужно сделать неизменяемым: Для доступа к репозиториям AstraLinux и Элтекс нужно указать локальный DNS или глобальный (для примера 8.8.8.8 или 77.88.8.8) Добавить в файл /etc/dnsmasq.d/ecss строки server=<Ipadd DNS сервера> (в примере 77.88.8.8) : Перезапустить сервис:Настройка преобразование DNS имени в IP адрес

sudo nano /etc/resolv.conf

domain eltex.loc

search eltex.loc

nameserver 127.0.0.1

sudo chattr +i /etc/resolv.conf

sudo sh -c "echo 'server=77.88.8.8' >> /etc/dnsmasq.d/ecss"

sudo systemctl restart dnsmasq.service

Установка Postgres

Установка пакета ecss-postgres-bdr-ssw

Выполняется последовательно, первым устанавливается на сервере который работает в режиме "Master"

sudo apt install -y ecss-postgres-bdr-ssw

При конфигурации пакета ecss-postgres-bdr-ssw будут заданы вопросы:

| Вопросы ecss-postgres-bdr-ssw | Ответы для ecss1 (Master) | Пример |

|---|---|---|

| Текущий IP-адрес сетевого интерфейса. | Выбрать из списка IP-адрес для работы с Postgres | |

| Установка в кластере? | Yes (значение по умолчанию) | |

| Является ли этот узел мастером? | Yes (необходимо выбрать) |

sudo apt install -y ecss-postgres-bdr-ssw

При конфигурации пакета ecss-postgres-bdr-ssw будут заданы вопросы:

| Вопросы ecss-postgres-bdr-ssw | Ответы для ecss2 (Slave) | Пример |

|---|---|---|

| Текущий IP-адрес сетевого интерфейса. | Выбрать из списка IP-адрес для работы с Postgres | |

| Установка в кластере? | Yes (значение по умолчанию) | |

| Является ли этот узел мастером? | No (значение по умолчанию) | |

| IP-адрес, используемый для подключения к кластеру: | Указать IP-адрес Master (ecss1) |

Проверить корректность настройки репликации

Во время установки в директорию /srv/ecss/ecss-postgres-bdr-ssw устанавливаются скрипт postgresbdr_ssw.sh

Для проверки репликации выполнить следующие команды:

cd /srv/ecss/ecss-postgres-bdr-ssw

sudo ./postgresbdr_ssw.sh check

Вывод на хостах должен быль одинаковый:

sudo ./postgresbdr_ssw.sh checkEnter master ip pleaseLike 10.150.150.1510.0.10.41Enter slave ip please10.0.10.42Press enter with empty passwordПросто щелкайте Enter не вводя парольq - выход из просмотра таблицы (если необходимо)таблица нод на мастере по ecss_storekeeper_dbтаблица нод на слейве по ecss_storekeeper_dbтаблица коннекций на мастер по ecss_storekeeper_db conn_sysid | conn_dsn ---------------------+--------------------------------------------------------------------------------------- 7577617967861174292 | host=10.0.10.41 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1 7577618825220177940 | host=10.0.10.42 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1(2 строки)таблица коннекций на слейве по ecss_storekeeper_db conn_sysid | conn_dsn ---------------------+--------------------------------------------------------------------------------------- 7577617967861174292 | host=10.0.10.41 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1 7577618825220177940 | host=10.0.10.42 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1(2 строки)

sudo ./postgresbdr_ssw.sh checkEnter master ip pleaseLike 10.150.150.1510.0.10.41Enter slave ip please10.0.10.42Press enter with empty passwordПросто щелкайте Enter не вводя парольq - выход из просмотра таблицы (если необходимо)таблица нод на мастере по ecss_storekeeper_dbтаблица нод на слейве по ecss_storekeeper_dbтаблица коннекций на мастер по ecss_storekeeper_db conn_sysid | conn_dsn ---------------------+--------------------------------------------------------------------------------------- 7577617967861174292 | host=10.0.10.41 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1 7577618825220177940 | host=10.0.10.42 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1(2 строки)таблица коннекций на слейве по ecss_storekeeper_db conn_sysid | conn_dsn ---------------------+--------------------------------------------------------------------------------------- 7577617967861174292 | host=10.0.10.41 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1 7577618825220177940 | host=10.0.10.42 port=5439 dbname=ecss_storekeeper_db user=postgres password=postgres1(2 строки)

Установка ecss-node

Установка обязательного пакета ecss-node включает в себя установку и первоначальную настройку основных подсистем.

В системе уже должен быть установлен пакет ecss-postgres-bdr-ssw

Для установки пакета ecss-node выполните команду:

sudo apt install -y ecss-node

Во время установки пакета создается пользователь ssw, от имени которого запускаются все сервисы ecss*. Создаются необходимые каталоги, выполняется настройка DNS, идет настройка SSL-сертификатов.

При установке также будет установлен пакет ecss-user

Установка на сервере ecss1

Во время установки будет предложено настроить параметры, необходимые для формирования конфигурационных файлов, примеры ответов следует ниже.

| Вопросы ecss-user | Ответы для ecss1 | Пример |

|---|---|---|

| Хотите ли вы использовать стандартные настройки? | Yes (значение по умолчанию) | |

| Вопросы ecss-node | Ответы для ecss1 | Пример |

| Идентификатор ECSS-узла в формате DNS (Настройка имени кластера): (в примере abf.test) | abf.test (необходимо ввести) | |

| Хотите ли вы использовать стандартные настройки? | Yes (значение по умолчанию) | |

| Вопросы ecss-user | Ответы для ecss1 | Пример |

| Максимальный размер несжатого дампа в байтах. | 8G (значение по умолчанию) | |

| Максимальный размер сжатого дампа в байтах. | 2G (значение по умолчанию) | |

| Максимальный размер, который может занять каталог /var/lib/systemd/coredump: | default (значение по умолчанию) | |

| Минимальный объем свободного дискового пространства в байтах. | 30G (значение по умолчанию) | |

Сохраните в безопасное место и удалите файл /etc/ecss/ssl/ecss10root.key! | Ok (значение по умолчанию) | |

После установки пакета ecss-node на хосте ecss1, выполните команду "sudo usermod -a -G ssw <Имя_пользователя>" на хосте ecss1.

sudo usermod -a -G ssw eltex

Затем выполите установку на хосте ecss2.

Используйте режим "Скопировать существующие сертификаты (copy) по ssh" с сервера ecss1

Установка на сервере ecss2

sudo apt install -y ecss-node

Во время установки будет предложено настроить параметры, необходимые для формирования конфигурационных файлов, примеры ответов следует ниже.

| Вопросы ecss-user | Ответы для ecss2 | Пример |

|---|---|---|

| Хотите ли вы использовать стандартные настройки? | No (значение по умолчанию) | |

| Хотите ли вы выключить ежедневное обновление apt-пакетов? | Yes (значение по умолчанию) | |

| Как вы хотите сконфигурировать сертификаты? | copy (необходимо выбрать) | |

| Вы хотите установить сертификаты в систему? | Yes (значение по умолчанию) | |

| Каким методом вы хотите скопировать сертификаты? | ssh (необходимо выбрать) | |

| Введите имя хоста для подключения: | ecss1 (необходимо ввести) | |

| Введите порт хоста для подключения: | 22 (значение по умолчанию) | |

| Введите логин для подключения: (для примера eltex) | eltex (необходимо ввести) | |

| Какой метод авторизации использовать? | password (необходимо выбрать) | |

| Введите пароль для подключения: | ||

| Введите путь до сертификатов: | /etc/ecss/ssl (значение по умолчанию) | |

| Вопросы ecss-node | Ответы для ecss2 | Пример |

| Идентификатор ECSS-узла в формате DNS (Настройка имени кластера): (в примере abf.test) | abf.test (необходимо ввести) | |

| Хотите ли вы использовать стандартные настройки? | Yes (значение по умолчанию) | |

| Вопросы ecss-user | Ответы для ecss2 | Пример |

| Максимальный размер несжатого дампа в байтах. | 8G (значение по умолчанию) | |

| Максимальный размер сжатого дампа в байтах. | 2G (значение по умолчанию) | |

| Максимальный размер, который может занять каталог /var/lib/systemd/coredump: | default (значение по умолчанию) | |

| Минимальный объем свободного дискового пространства в байтах. | 30G (значение по умолчанию) | |

Сохраните в безопасное место и удалите файл /etc/ecss/ssl/ecss10root.key! | Ok (значение по умолчанию) | |

Проверить статус сервисов следующей командой:

systemctl is-active ecss-core ecss-pa-sip ecss-ds ecss-mediator ecss-mycelium

В случае статуса "active" продолжаем дальше, в случае статуса "inactive" выполнить команду "sudo systemctl restart ecss-<имя пакета>"

systemctl is-active ecss-core ecss-pa-sip ecss-ds ecss-mediator ecss-mycelium active active active active active

Установка паспорта и лицензий

Под паспортом системы ECSS-10 понимается связь определенной инсталляции (SSW_ID) с USB-ключом. Паспорт гарантирует, что заказчик не сможет запустить больше подсистем DS с заданным SSW_ID, чем количество USB-ключей. Система без паспорта не работает.

Лицензионный ключ содержит в себе информацию о лицензионных ограничениях. Информация привязана к определенному SSW_ID. Позволяет добавлять лицензионные ограничения к определенной инсталляции системы ECSS-10. Если не добавлено ни одной лицензии, то действуют ограничения по умолчанию. Например, по умолчанию разрешено не более двух одновременных вызовов. Добавляя лицензию, можно расширить это количество до произвольных значений.

<licence> — последовательность цифр, букв и других символов без кавычек, следующая за строкой Licence: в файле лицензии.

<passport> — последовательность цифр, букв и других символов без кавычек, следующая за строкой Passport: в файле лицензии.

Если данные лицензии и паспорта будут введены корректно, то система выдаст подтверждение: ОК.

ВАЖНО

Перед началом работы проверьте наличие Token в системе.

Для проверки работы токена можно использовать приложение pkcs11-tool. Возможно проверить следующее:

Вывести общую информацию для ключа:

- для eToken:

pkcs11-tool --module /usr/lib/libeToken.so -I Cryptoki version 2.1 Manufacturer SafeNet, Inc. Library eToken PKCS#11 (ver 8.1) Using slot 0 with a present token (0x0)

- для Рутокен:

pkcs11-tool --module /usr/lib/ecss/ecss-ds/lib/lpm_storage-<VERSION>/priv/x64/librtpkcs11ecp.so -I Cryptoki version 2.20 Manufacturer Aktiv Co. Library Rutoken ECP PKCS #11 library (ver 1.5) Using slot 0 with a present token (0x0)

Расположение модуля для Рутокен может отличаться в зависимости от версии подсистемы DS. В общем случае файл располагается в /usr/lib/ecss/ecss-ds/lib/lpm_storage-<ВЕРСИЯ ПОДСИСТЕМЫ>/priv/x64/librtpkcs11ecp.so

Для проверки можно использовать общую команду pkcs11-tool --module $(find /usr/lib/ecss/ecss-ds/lib/ -name librtpkcs11ecp.so | head -n1) -L

Остановите пакеты ecss-mycelium и ecss-ds на втором хосте. Если этого не сделать, то паспорт и лицензия могут быть не добавлены с первого раза.

sudo systemctl stop ecss-mycelium

sudo systemctl stop ecss-ds

Перейдите в CLI - CoCon:

ssh admin@localhost -p 8023

ssh admin@localhost -p 8023 The authenticity of host '[localhost]:8023 ([127.0.0.1]:8023)' can't be established. RSA key fingerprint is SHA256:/reVfo2jbltLDwNpZbiLvibXBwaWJbfSChd1M7wm1nc. This key is not known by any other names Are you sure you want to continue connecting (yes/no/[fingerprint])? yes Warning: Permanently added '[localhost]:8023' (RSA) to the list of known hosts. admin@localhost's password: password

Проверьте состояние системы:

/system-status Checking... ┌─┬───────────────┬───────────────────────────┬───────────────┬────────────┬───────┐ │ │ Node │ Release │ Erlang nodes │Mnesia nodes│Uptime │ ├─┼───────────────┼───────────────────────────┼───────────────┼────────────┼───────┤ │ │ds1@ecss1 │ecss-ds-3.17.1.0.1656 │ds1@ecss1 │ds1@ecss1 │27m 28s│ │ │mycelium1@ecss1│ecss-mycelium-3.17.1.0.1656│mycelium1@ecss1│not running │27m 29s│ └─┴───────────────┴───────────────────────────┴───────────────┴────────────┴───────┘

Чтобы узлы системы смогли встать в работу, надо сконфигурировать систему указав имена хостов на которых развёрнуты ecss-сервисы.

Команда в коконе: /system/clusters/set [<host1>, <host2>, ... <hostN>].

В примере кластера из 2-х хостов (имя хоста ecss1 и ecss2) выполнить команду :

/system/clusters/set [ecss1, ecss2]

Выйти из CoCon ("exit"),

Перезапустить ecss сервисы командой:

sudo systemctl restart ecss-core ecss-pa-sip ecss-ds ecss-mediator ecss-mycelium

Далее необходимо загрузить паспорт и лицензии в систему:

/cluster/storage/ds1/licence/set-passport <ssw passport>

/cluster/storage/ds1/licence/add <ssw licence>

Выйдите из CoCon ("exit")

И перезапустите сервисы ecss-ds и ecss-mycelium на первом и запустите остальные сервисы втором хосте:

sudo systemctl restart ecss-mycelium

sudo systemctl restart ecss-ds

sudo systemctl start ecss-core ecss-pa-sip ecss-mediator

sudo systemctl start ecss-mycelium ecss-ds ecss-core ecss-pa-sip ecss-mediator

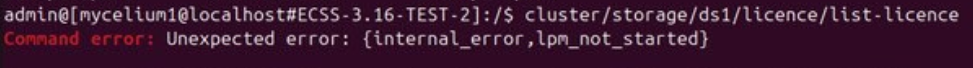

Выполнить проверку лицензий, для этого зайти в CoCon :

ssh admin@localhost -p8023

Проверить наличие лицензией:

/cluster/storage/ds1/licence/list-licence

Видим активную лицензию №1 (не ECSS DEFAULT)

/cluster/storage/ds1/licence/list-licence ┌──┬───────────────────┬────────────────┬──────┬────────────────────────────────────────────┬────────────────────┬────────────┐ │Id│Creation date(UTC) │ SSW ID │Active│ Description │Expiration date(UTC)│ Time left │ ├──┼───────────────────┼────────────────┼──────┼────────────────────────────────────────────┼────────────────────┼────────────┤ │1 │31.10.2024 14:16:00│ECSS 010070 │* │Eltex SC softswitch │31.12.2025 23:59:59 │112d 21h 31m│ │0 │ │ECSS DEFAULT │ │Default licence │ │ │ └──┴───────────────────┴────────────────┴──────┴────────────────────────────────────────────┴────────────────────┴────────────┘

в случае если получили такую ошибку :

проверить имя хоста, командой cat /etc/hostname

в случае имени хоста отличного от ecss1 заменить на ecss1, выполнив команду sudo nano /etc/hostname

Выйдите из CoCon ("exit").

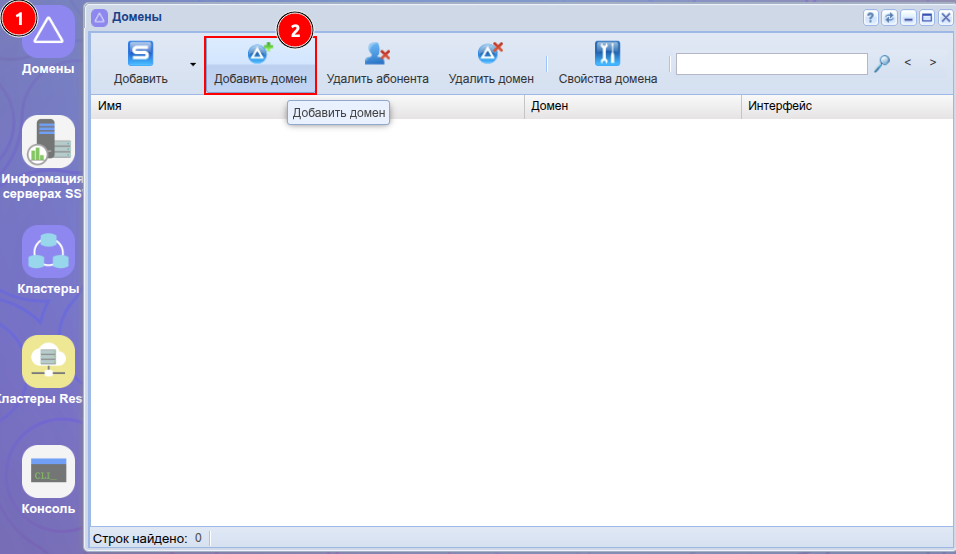

Добавление услуг

Добавление всех услуг указных в лицензии:

/cluster/storage/ds1/ss/install ds1@ecss1 ss_* Successfully installed: /var/lib/ecss/ss/ss_dnd.xml Successfully installed: /var/lib/ecss/ss/ss_clir.xml ... Successfully installed: /var/lib/ecss/ss/ss_chunt.xml

Выйти из CoCon ("exit").

Так же требуется выполнить конфигурацию для Sip адаптера , выполнив следующую команду:

sudo systemctl edit ecss-pa-sip.service

Добавить в конфигурационный файл следующие данные:

[Service] LimitNOFILE=65536

Перезагрузите конфигурацию

sudo systemctl daemon-reload

Актуализировать конфигурационный файл, выполнив перезагрузку сервера:

sudo reboot

Установка остальных пакетов ecss и их настройка

Для корректной работы кластерной конфигурации необходимо настроить работу RestFS на базе GlusterFS-сервера.

Следует проверить в файле /etc/dnsmasq.d/ecss-broker, что адреса primary и secondary broker соответствуют указанным при инсталляции пакета ecss-node.

cat /etc/dnsmasq.d/ecss-broker

Пример содержания файла на ecss1 и ecss2 (содержимое файлов должно быть одинаковым на обоих серверах):

address=/primary.broker.ecss/10.0.10.41 address=/secondary.broker.ecss/10.0.10.42

glusterfs

Выполните настройку glusterfs для ecss-restfs на первом хосте (ecss1),

для этого установите пакеты glusterfs-server и attr на обоих хостах:

sudo apt install glusterfs-server attr

Запустите glasterd на обоих хостах кластера:

sudo systemctl start glusterd

После запуска выполните создание связи с удаленным виртуальным хостом, выполните команду на ecss1:

sudo gluster peer probe 10.0.10.42

Проверьте наличие созданной связи, выполните команду на ecss2:

sudo gluster peer status

Должна появиться информация о первом хосте — ecss1:

Number of Peers: 1 Hostname: ecss1 Uuid: d7319720-ea3a-43a4-a7d5-e97bf9d205b9 State: Peer in Cluster (Connected)

Выполните аналогичную проверку на другом хосте — ecss1. Вы также должны увидеть информацию о партнере ecss2 (или его IP-адрес).

sudo gluster peer status Number of Peers: 1 Hostname: 10.0.10.42 Uuid: f405dbb1-4f6d-4f2f-a116-f56197d18788 State: Peer in Cluster (Connected)

Создайте кластер для репликации, запустите репликацию и посмотрите ее статус, выполните следующие команды на ecss1:

sudo gluster volume create ecss_volume replica 2 transport tcp 10.0.10.41:/var/lib/ecss/glusterfs 10.0.10.42:/var/lib/ecss/glusterfs force

sudo gluster volume start ecss_volume

sudo gluster volume info

Таким образом, статус репликации будет выглядеть следующим образом, необходимо обратить внимание на поля "Status" и "Bricks" — они должны иметь следующий вид:

Volume Name: ecss_volume Type: Replicate Volume ID: 3bfc7587-0f85-48ed-9612-21f0d79c6e52 Status: Started Snapshot Count: 0 Number of Bricks: 1 x 2 = 2 Transport-type: tcp Bricks: Brick1: 10.0.10.41:/var/lib/ecss/glusterfs Brick2: 10.0.10.42:/var/lib/ecss/glusterfs Options Reconfigured: transport.address-family: inet nfs.disable: on performance.client-io-threads: off

Чтобы смонтировать glusterfs раздел, выполните на обоих хостах ecss1 и ecss2 следующие действия:

- Создайте новый systemd unit

sudo nano /etc/systemd/system/ecss-glusterfs-mount.service

- Добавьте в него следующую конфигурацию:

[Unit] Description=mount glusterfs After=network.target Requires=network.target [Service] RemainAfterExit=no Type=forking RestartSec=10s Restart=always ExecStart=/sbin/mount.glusterfs localhost:/ecss_volume /var/lib/ecss/restfs -o fetch-attempts=10 ExecStop=/bin/umount /var/lib/ecss/restfs [Install] WantedBy=multi-user.target

- Добавить unit в автозагрузку на обоих хостах.

sudo systemctl enable glusterd.service

sudo systemctl enable ecss-glusterfs-mount.service

- Создайте директорию для корректной установки RestFS на обоих хостах:

sudo mkdir /var/lib/ecss/restfs

- Если хосты не могут быть перезагружены, то можно выполнить следующие команды на обоих хостах:

sudo systemctl daemon-reload

sudo systemctl restart ecss-glusterfs-mount.service

Проверьте, что раздел под монтировался, для этого на обоих хостах выполните команду - df -h:

df -h

df -h /dev/sda8 4,5G 213M 4,1G 5% /var/log /dev/sda5 37G 48M 35G 1% /var/lib/ecss/ecss-media-server/records /dev/sda6 19G 44M 18G 1% /var/lib/ecss/cdr /dev/sda7 19G 44M 18G 1% /var/lib/ecss/statistics /dev/sda9 19G 7,6G 9,7G 44% /var/log/ecss localhost:/ecss_volume 46G 59M 44G 1% /var/lib/ecss/restfs

При просмотре информации должен появиться подмонтированный раздел —

localhost:/ecss_volume 46G 59M 44G 1% /var/lib/ecss/restfs

Установка пакета ecss-restfs и его настройка

sudo apt install -y ecss-restfs

Установка ecss-restfs. В ходе установки нужно будет ответить на ряд вопросов для создания необходимых конфигурационных файлов. Также инсталлятор предложит установить и настроить пакет Text2speech от Yandex.

| Вопросы ecss-restfs | Ответы для ecss1/ecss2 | Пример |

|---|---|---|

| Хотите ли вы использование функции Text To Speeh (Use TTS service) | No (значение по умолчанию) | |

| Хотите настроить сервис телефонной книги (Configure phone book) | No (значение по умолчанию) | |

| Хотите настроить сервис распознавания речи (Configure speech recognition service) | No (значение по умолчанию) | |

| Ничего не выбирать | Ok (необходимо выбрать) |

после установки пакета ecss-restfs проверьте наличие wav файлов авто-информатора в директории /var/lib/ecss/restfs/system/sounds/ командой:

ls -la /var/lib/ecss/restfs/system/sounds/

наличие wav файлов в указной выше директории говорит о корректности установки пакета ecss-restfs.

Проверить доступность этих файлов извне, для этой проверки выполним поочередно команду на ecss1 и ecss2:

wget http://ecss1:9990/system/sounds/ai_you.wav

wget http://ecss2:9990/system/sounds/ai_you.wav

wget http://ecss1:9990/system/sounds/ai_you.wav --2025-09-16 08:27:36-- http://ecss1:9990/system/sounds/ai_you.wav Распознаётся ecss1 (ecss1)… 10.0.10.41 Подключение к ecss1 (ecss1)|10.0.10.41|:9990... соединение установлено. HTTP-запрос отправлен. Ожидание ответа… 200 OK Длина: 11670 (11K) [audio/x-wav] Сохранение в: «ai_you.wav» ai_you.wav.1 100%[========================================================================================>] 11,40K --.-KB/s за 0s 2025-09-16 08:27:36 (81,5 MB/s) - «ai_you.wav» сохранён [11670/11670] wget http://ecss2:9990/system/sounds/ai_you.wav --2025-09-16 08:27:44-- http://ecss2:9990/system/sounds/ai_you.wav Распознаётся ecss2 (ecss2)… 10.0.10.42 Подключение к ecss2 (ecss2)|10.0.10.42|:9990... соединение установлено. HTTP-запрос отправлен. Ожидание ответа… 200 OK Длина: 11670 (11K) [audio/x-wav] Сохранение в: «ai_you.wav.1» ai_you.wav.2 100%[========================================================================================>] 11,40K --.-KB/s за 0s 2025-09-16 08:27:44 (272 MB/s) - «ai_you.wav.1» сохранён [11670/11670]

проверочные файлы можно удалить

rm ai_you.wav rm ai_you.wav.1

если SSW работает в кластере

В случае кластерной конфигурации, для предотвращения одновременной обработки/конвертации/удаления одного файла (.pcm/.wav/.mp3) на разных серверах ecss1/ecss2 → сервис ecss-restfs-crawler должен быть запущен только на одном из серверов кластера. Для этого на сервере ecss2 выполнить следующие команды:

sudo systemctl disable ecss-restfs-crawler.timer

sudo systemctl stop ecss-restfs-crawler.timer

Установка media и web пакетов ecss и их настройка

sudo apt install -y ecss-media-server ecss-web-conf

Для медиасервера (ecss-media-server/MSR) возможно начальное конфигурирование с записью параметров в файл конфигурации,

для этого нужно провести конфигурацию transport bind-addr,mcc bind-addres:

| Вопросы ecss-media-server | Ответы для ecss1 | Ответы для ecss2 | Пример |

|---|---|---|---|

| [ MSR SIP ] Введите bind-ip адрес (Enter) | 10.0.20.41 (необходимо ввести) | 10.0.20.42 (необходимо ввести) | |

| [MSR Control-Channel] Введите bind-ip-адрес | 10.0.20.41 (необходимо ввести) | 10.0.20.42 (необходимо ввести) |

Web-конфигуратор позволяет сделать управление системой более наглядным и комфортным. Установка web-конфигуратора не является обязательной, но рекомендуется.

Также при установке пакета ecss-web-conf автоматически устанавливается пакет ecss-subsriber-portal-ui. Приложение "Портал абонента" системы ECSS-10 позволяет абонентам системы самостоятельно управлять услугами, просматривать информацию по совершенным вызовам, активным конференциям, а также настраивать собственные IVR-скрипты для входящих вызовов. Описание работы веб-конфигуратора приведено в разделе "Портал абонента".

| Вопросы ecss-web-conf | Ответы для ecss1/ecss2 | Пример |

|---|---|---|

| Хотите ли вы использовать стандартные настройки? | Yes (значение по умолчанию) |

После формирования конфигураций по умолчанию переходим в директорию, в которой находятся файлы конфигурации и производим их проверку:

cd /etc/ecss/ecss-media-server/

cat /etc/ecss/ecss-media-server/config.xml

Конфигурация для msr: файл - config.xml, в директории conf.d файл default.xml.

По своей сути default.xml — это дополнение config.xml, которое определяет секцию аккаунтов. Это сделано для того, чтобы после обновлений пакета данная конфигурация оставалась неизменной. Вид config.xml представлен здесь: файл конфигурации.

<?xml version="1.0" encoding="utf-8"?>

<config date="02:30:33 07.12.2023">

<general log-level="3" log-rotate="yes" max-calls="8192" max-in-group="512" load-sensor="media" load-delta="10" calls-delta="100" spool-dir-size="100M" log-name="msr.log" log-path="/var/log/ecss/media-server" use-srtp="disabled" enable-ice-transport="no" ice-update="no" aggressive-ice="yes" stun-server="" suspicious-mode="no"/>

<transport bind-addr="10.0.20.41" port="5040" transport="udp+tcp"/>

<!-- By default configured public TURN-server -->

<turn-server use-turn="no" host="numb.viagenie.ca" user="webrtc@live.com" password="muazkh"/>

<media mixer-clock-rate="8000" use-vad="no" cng-level="0" jb-size="60" rtcp-timeout="0" rtp-timeout="350" udp-src-check="no" cn-multiplier="3" port-start="12000" port-range="2048" tias-in-sdp="no" thread-cnt="2" vid-enc-threads="2" vid-dec-threads="2" video-conf-layout="evenly" keyframe-interval="1000" vid-decode-delay="100" silence-threshold="-30" dtmf-flash-disable="no" video-dscp="0" other-dscp="0" dummy-video-src="/usr/share/ecss-media-server/video/dummy_video.yuv" video-enc-width="640" video-enc-height="360" finalsilence="1000" rtcp-stat-dump="yes" silent-codec-switch="yes"/>

<codec pcma="1" pcmu="2" ilbc="0" gsm="0" g722="3" g726="0" g729="0" speex="0" l16="0" g7221="0" opus="0" h264="1" h263-1998="2" t38="1" tel-event-pt="0"/>

<accounts>

<!-- <dynamic msr_name="msr.name"

realm="sip:127.0.0.1:5000"

dtmf_mode="rfc+inband+info"

auth_name="user"

auth_password="password" /> -->

</accounts>

<pbyte>

<mcc bind-addr="10.0.20.41" port="5700"/>

</pbyte>

<conf_dir path="/etc/ecss/ecss-media-server/conf.d"/>

<rtp>

<auto addr-v4=""/>

</rtp>

</config>

По умолчанию после инсталляции ECSS-10 активизирует только кодеки — pcma, pcmu, g722, h264, h263-1998, t38. Остальные имеют статус =0 = выкл. Если требуется активировать остальные кодеки, в редакторе nano измените приоритет с 0 на цифру приоритета (уровень приоритета не должен повторятся для сервиса audio/video/fax)

sudo nano /etc/ecss/ecss-media-server/config.xml

строчку -

<codec pcma="1" pcmu="2" ilbc="0" gsm="0" g722="3" g726="0" g729="0" speex="0" l16="0" g7221="0" opus="0" h264="1" h263-1998="2" t38="1" tel-event-pt="0"/>

привести к виду -

<codec pcma="1" pcmu="2" ilbc="6" gsm="4" g722="3" g726="11" g729="5" speex="7" l16="8" g7221="9" opus="10" h264="1" h263-1998="2" t38="1" tel-event-pt="0"/>

Недопустимо указывать у разных кодеков одинаковый приоритет, для примера g722="5" g729="5". В этом случае media-server не сможет работать корректно.

За исключением "0" - выключено.

Рассмотрим секцию аккаунтов (файл default.xml):

После инсталляции пакетов в фале будет указан ip-add 127.0.0.1 , и только для одного хоста.

cat /etc/ecss/ecss-media-server/conf.d/default.xml

<?xml version="1.0"?>

<config>

<accounts>

<dynamic msr_name="msr.ecss1" realm="sip:127.0.0.1:5000" dtmf_mode="rfc+inband+info" auth_name="user" auth_password="password"/>

</accounts>

</config>

Требуется указать в конфигурации для обоих хостов, реальные IP-add.

Необходимо привести содержимое файла к виду указанному снизу (в примере ecss1 имеет IP-add 10.0.20.41/ ecss2 - 10.0.20.42):

sudo nano /etc/ecss/ecss-media-server/conf.d/default.xml

| Настройка msr для ecss1 (/etc/ecss/ecss-media-server/conf.d/default.xml) | Настройка msr для ecss2 (/etc/ecss/ecss-media-server/conf.d/default.xml) |

|---|---|

<?xml version="1.0"?>

<config>

<accounts>

<dynamic msr_name="msr.ecss1" realm="sip:10.0.20.41:5000" dtmf_mode="rfc+inband+info" auth_name="user" auth_password="password">

<via dynamic-ifaces="no">

<iface name="net.20" ip="10.0.20.41"/>

</via>

</dynamic>

<dynamic msr_name="msr.ecss1" realm="sip:10.0.20.42:5000" dtmf_mode="rfc+inband+info" auth_name="user" auth_password="password">

<via dynamic-ifaces="no">

<iface name="net.20" ip="10.0.20.42"/>

</via>

</dynamic>

</accounts>

</config>

| <?xml version="1.0"?>

<config>

<accounts>

<dynamic msr_name="msr.ecss2" realm="sip:10.0.20.42:5000" dtmf_mode="rfc+inband+info" auth_name="user" auth_password="password">

<via dynamic-ifaces="no">

<iface name="net.20" ip="10.0.20.42"/>

</via>

</dynamic>

<dynamic msr_name="msr.ecss2" realm="sip:10.0.20.41:5000" dtmf_mode="rfc+inband+info" auth_name="user" auth_password="password">

<via dynamic-ifaces="no">

<iface name="net.20" ip="10.0.20.41"/>

</via>

</dynamic>

</accounts>

</config>

|

Указываем текущие настройки, согласно которым происходит регистрация msr на core.

Основными параметрами здесь являются: msr_name и realm:

- msr_name — параметр, определяющий название msr. (рекомендуется задавать msr. и к какому хосту он принадлежит, например msr.ecss1);

- realm — определяет адрес для регистрации на ядре. Точка входа по умолчанию — порт 5000.

После изменения конфигурации файлов /etc/ecss/ecss-media-server/config.xml и /etc/ecss/ecss-media-server/conf.d/default.xml необходимо выполнить перезапуск сервиса ecss-media-server, чтобы изменения вступили в силу, следующей командой:

sudo systemctl restart ecss-media-server

Настройка VRRP для SIP-адаптера

Для Astra Linux

Если ECSS-10 установлен на Astra Linux, то необходимо изменить скрипт проверки доступности контрольного SIP-порта /usr/bin/ecss_pa_sip_port:

#!/bin/bash netstat -plane | grep $1 #nc -z 127.0.0.1 $1

Выполните настройку VRRP для SIP-адаптера, для этого на обоих хостах создайте файлы следующего содержания:

Глобального конфигурационного файла keepalived.conf. На обоих хостах содержимое файла одинаковое:

sudo nano /etc/keepalived/keepalived.conf

Скопируйте и вставьте следующий текст в файл /etc/keepalived/keepalived.conf

global_defs {

vrrp_version 3 # версия протокола VRRP (2 или 3)

script_user nobody # ограниченный в правах системный пользователь, от которого будут запускаться скрипты проверки доступности

enable_script_security # не запускать скрипты от root, если часть пути к ним доступна на запись для обычных пользователей

}

include /etc/keepalived/sip.conf

Выполните настройку VRRP для SIP-адаптера, для этого на обоих хостах создайте файлы следующего содержания:

sudo nano /etc/keepalived/sip.conf

| etc/keepalived/sip.conf для ecss1 | etc/keepalived/sip.conf для ecss2 |

|---|---|

на ecss1 vrrp_script check_sip {

script "/usr/bin/ecss_pa_sip_port 65535"

interval 2

timeout 2

}

# Конфигурация адреса для первого виртуального адреса SIP-адаптера

vrrp_instance SIP1 {

state MASTER # Исходное состояние при старте

interface net.20 # Имя сетевого интерфейса, на котором будет работать протокол VRRP

virtual_router_id 31 # Уникальный идентификатор роутера (0..255)

priority 100 # Приоритет (0..255) чем выше - тем больше

advert_int 1 # Интервал рассылки уведомлений (с)

preempt_delay 60 # Интервал ожидания мастера при старте демона (с) при исходном состоянии BACKUP

unicast_src_ip 10.0.20.41 # Собственный реальный IP-адрес

unicast_peer {

10.0.20.42 # Реальный IP-адрес соседа

}

virtual_ipaddress {

# Виртуальный IP-адрес и маска

# dev - сетевой интерфейс, на котором будет поднят виртуальный адрес

# label - метка виртуального интерфейса (для удобства идентификации)

10.0.20.31/24 dev net.20 label net.20:SIP1

}

track_script {

check_sip

}

}

# Конфигурация адреса для второго виртуального адреса SIP-адаптера

vrrp_instance SIP2 {

state BACKUP # Исходное состояние при старте

interface net.20 # Имя сетевого интерфейса, на котором будет работать протокол VRRP

virtual_router_id 32 # Уникальный идентификатор роутера (0..255)

priority 50 # Приоритет (0..255) чем выше - тем больше

advert_int 1 # Интервал рассылки уведомлений (с)

preempt_delay 60 # Интервал ожидания мастера при старте демона (с) при исходном состоянии BACKUP

unicast_src_ip 10.0.20.41 # Собственный реальный IP-адрес

unicast_peer {

10.0.20.42 # Реальный IP-адрес соседа

}

virtual_ipaddress {

# Виртуальный IP-адрес и маска

# dev - сетевой интерфейс, на котором будет поднят виртуальный адрес

# label - метка виртуального интерфейса (для удобства идентификации)

10.0.20.32/24 dev net.20 label net.20:SIP2

}

}

| на ecss2 vrrp_script check_sip {

script "/usr/bin/ecss_pa_sip_port 65535"

interval 2

timeout 2

}

# Конфигурация адреса для первого виртуального адреса SIP-адаптера

vrrp_instance SIP1 {

state BACKUP # Исходное состояние при старте

interface net.20 # Имя сетевого интерфейса, на котором будет работать протокол VRRP

virtual_router_id 31 # Уникальный идентификатор роутера (0..255)

priority 50 # Приоритет (0..255) чем выше - тем больше

advert_int 1 # Интервал рассылки уведомлений (с)

preempt_delay 60 # Интервал ожидания мастера при старте демона (с) при исходном состоянии BACKUP

unicast_src_ip 10.0.20.42 # Собственный реальный IP-адрес

unicast_peer {

10.0.20.41 # Реальный IP-адрес соседа

}

virtual_ipaddress {

# Виртуальный IP-адрес и маска

# dev - сетевой интерфейс, на котором будет поднят виртуальный адрес

# label - метка виртуального интерфейса (для удобства идентификации)

10.0.20.31/24 dev net.20 label net.20:SIP1

}

}

# Конфигурация адреса для второго виртуального адреса SIP-адаптера

vrrp_instance SIP2 {

state MASTER # Исходное состояние при старте

interface net.20 # Имя сетевого интерфейса, на котором будет работать протокол VRRP

virtual_router_id 32 # Уникальный идентификатор роутера (0..255)

priority 100 # Приоритет (0..255) чем выше - тем больше

advert_int 1 # Интервал рассылки уведомлений (с)

preempt_delay 60 # Интервал ожидания мастера при старте демона (с) при исходном состоянии BACKUP

unicast_src_ip 10.0.20.42 # Собственный реальный IP-адрес

unicast_peer {

10.0.20.41 # Реальный IP-адрес соседа

}

virtual_ipaddress {

# Виртуальный IP-адрес и маска

# dev - сетевой интерфейс, на котором будет поднят виртуальный адрес

# label - метка виртуального интерфейса (для удобства идентификации)

10.0.20.32/24 dev net.20 label net.20:SIP2

}

track_script {

check_sip

}

}

|

В данном случае была добавлена поддержка виртуальных интерфейсов со связью Master - Backup. Для ecss1 основным будет являться net.20:SIP1, а запасным — net.20:SIP2 соответственно. Важно учесть, что в конфигурации учтено использование адресных переменных. В секции interface требуется указать, на каком интерфейсе будут слушаться VRRP-сообщения, а в секции virtual_ipaddress требуется указать интерфейс, на котором будет восстановлен виртуальный адрес.

Выполните перезапуск keepalived:

sudo systemctl restart keepalived.service

для проверки правильности установки выполните команду ifconfig, в конце выходного сообщения вы должны видеть новый интерфейс - net.20:SIP1 с выбранным IP-адресом

ifconfig . . . net.20:SIP1: flags=4163<UP,BROADCAST,RUNNING,MULTICAST> mtu 1500 inet 10.0.20.31 netmask 255.255.255.0 broadcast 0.0.0.0 ether 08:00:27:6d:4f:02 txqueuelen 1000 (Ethernet)

Дальнейшая настройка

snpmd

Настройка SNMP описана в разделе "Управление и мониторинг по протоколу SNMP".

Настройка безопасности. SSH

Выполните настройку сервера SSH:

sudo nano /etc/ssh/sshd_config

Укажите в конфигурационном файле порт и адрес, по которому можно обратиться к серверу:

| Настройка ssh для ecss1 (/etc/ssh/sshd_config) | Настройка ssh для ecss2 (/etc/ssh/sshd_config) |

|---|---|

# This is the sshd server system-wide configuration file. See # This sshd was compiled with PATH=/usr/bin:/bin:/usr/sbin:/sbin # The strategy used for options in the default sshd_config shipped with Port 2000 <...> | # This is the sshd server system-wide configuration file. See # This sshd was compiled with PATH=/usr/bin:/bin:/usr/sbin:/sbin # The strategy used for options in the default sshd_config shipped with Port 2000 <...> |

Перезапустите ssh:

sudo systemctl restart ssh.service

Перезагрузка обоих хостов

sudo reboot